اعجبني الموضوع لانه تحدث عن العديد من النظريات والمشاريع خلال شرحه للمشكلة وحلولها.

للتوضيح في هالسرد سأنقل هنا نظرياته ورؤيته للمشكلة وليس رأيي.

سأحاول توضيحها قدر الامكان لاني انقلها من الانجليزي للعربي.

لا اتفق مع بعض نظرياته مثلا رؤيته لتطور البشرية وانها من سلالة القردة!

للتوضيح في هالسرد سأنقل هنا نظرياته ورؤيته للمشكلة وليس رأيي.

سأحاول توضيحها قدر الامكان لاني انقلها من الانجليزي للعربي.

لا اتفق مع بعض نظرياته مثلا رؤيته لتطور البشرية وانها من سلالة القردة!

نبدأ تلخيص المقابلة:

- شرح ان ChatGPT مش جديد وانه تم التحدث عن دراساته منذ ٢٠١٨ اي قبل ٤ سنوات من انطلاقه رسميا.

- شرح ان ChatGPT مش جديد وانه تم التحدث عن دراساته منذ ٢٠١٨ اي قبل ٤ سنوات من انطلاقه رسميا.

- تحدث ان GPT-3 تطور جيد ولكن GPT-4 سيكون اقوى وانه قادم قريبا (ملاحظة: اللقاء تم قبل الاعلان عن GPT-4 للعامه).

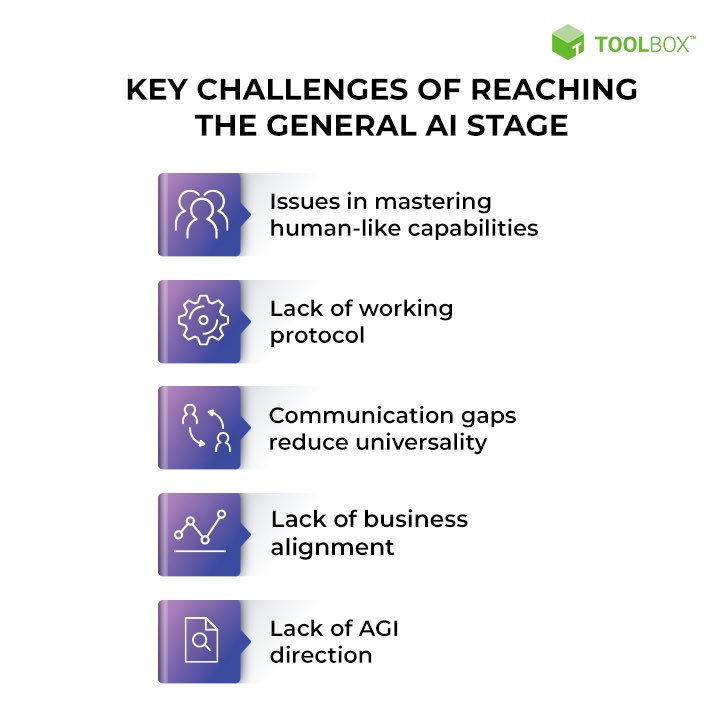

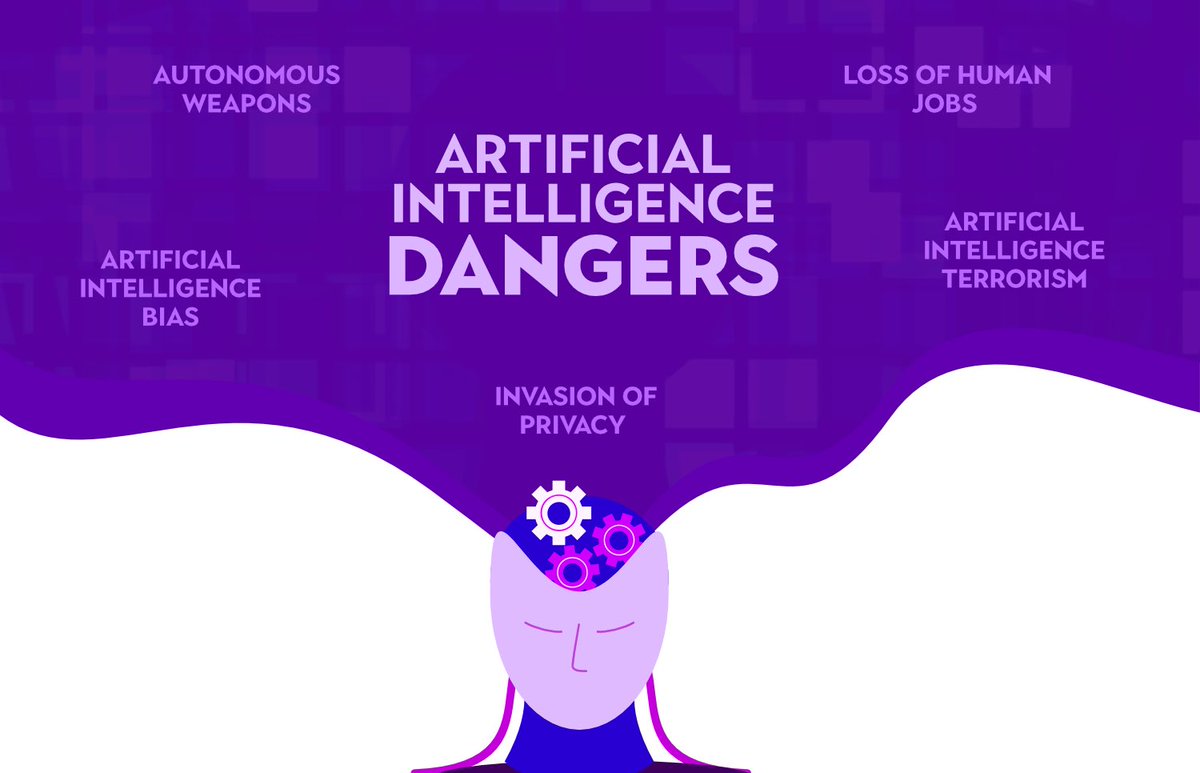

- يعتقد ان تقنيات الذكاء الاصطناعي الحالية غير مخيفة بعد وغير قادرة على احداث طفرة في طريقة تفكير الذكاء الاصطناعي بعد. فهي بالكاد اليوم تحاول ان تقلد الانسان وقدراته.

ولكن التطور في تسارع واضح.

ولكن التطور في تسارع واضح.

- تحدث عن مفهوم الذكاء العام General Intelligence وهو القدرة الطبيعية للانسان على فهم ما حوله وتخزين المعلومات واسترجاعها والتعلم باستمرار والاستفادة من تجاربه وخلافه.

- تحدث عن مفهوم الذكاء الخارق Super Intelligence وكيف انه يستطيع التفوق على الانسان ولكن في بعض القدرات مثل لعب الشطرنج.

ذلك ان لديه معلومات ضخمة جدا وتم تدريبه عليها ليتوقع حركاتك ويفكر كيف سيواجهها قبل ان تلعبها وبالتالي يستطيع ان يضع سيناريوهات كاملة لطريقة اللعب ويتنبأ بها

ذلك ان لديه معلومات ضخمة جدا وتم تدريبه عليها ليتوقع حركاتك ويفكر كيف سيواجهها قبل ان تلعبها وبالتالي يستطيع ان يضع سيناريوهات كاملة لطريقة اللعب ويتنبأ بها

- تحدث عن مفهوم مشابه لاحتمال لقائنا كبشر مع مخلوقات فضائية اخرى وذكر نظرية Grabby Aliens التي تتحدث عن الحضارات المختلفة الفضائية وتأثيرها.

شرح للنظرية في هذا الفيديو

youtu.be

شرح للنظرية في هذا الفيديو

youtu.be

- يعتقد ان الطريقة الوحيدة لكي لا يحدث ما يتوقعه، وهو ويتمنى ذلك بطبيعة الحال، هو ان يكون مخطئا في توقعاته حتى لا تحدث المصيبة لا سمح الله.

هو يتوقعها بالمستقبل ولا يعلم متى لانها مرتبطة بسرعة التطور في الذكاء الاصطناعي.

هو يتوقعها بالمستقبل ولا يعلم متى لانها مرتبطة بسرعة التطور في الذكاء الاصطناعي.

- تحدث ان مشكلة تطوير AI انه يستمر في اعطائنا نتائج مميزة (مثل ChatGPT) تعتبر مكافأة تحفزنا لتطوير ما هو افضل (spitting gold) حتى نصل لمرحلة تطوير AI يستطيع بناء ذكاء اصطناعي خارق لا يمكن السيطرة عليه وهنا تقع المصيبة!

ملاحظاتي الخاصة:

- بطبيعة الحال التطور امل حتمي ولا يمكن ايقافه لذا انا مع استمرار ابحاث تطور الذكاء الاصطناعي.

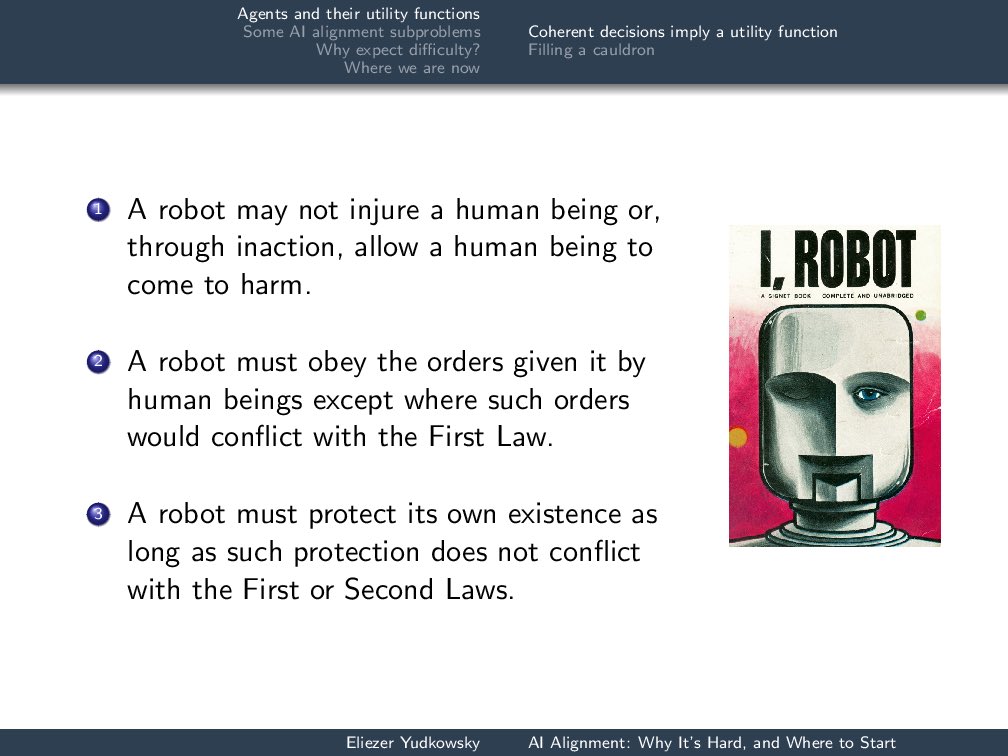

- ولكن هذا الحديث ليس بجديد وامكانية انقلاب الذكاء الاصطناعي ضد الانسان واردة لذا يجب الحماية ضدها.

- بطبيعة الحال التطور امل حتمي ولا يمكن ايقافه لذا انا مع استمرار ابحاث تطور الذكاء الاصطناعي.

- ولكن هذا الحديث ليس بجديد وامكانية انقلاب الذكاء الاصطناعي ضد الانسان واردة لذا يجب الحماية ضدها.

- حديثه كان محبط جدا وكأن النتيجة حتمية وهذا غير صحيح لانه في علم الغيب وبيد رب العالمين.

- يوجد امل في بعض المشاريع الصغيرة هنا وهناك. هنا مشروع تمكن فيه انسان من الفوز على الذكاء الاصطناعي القوي جدا بلعبة Go باستخدام استراتيجية اقترحها ذكاء اصطناعي آخر

ft.com

- يوجد امل في بعض المشاريع الصغيرة هنا وهناك. هنا مشروع تمكن فيه انسان من الفوز على الذكاء الاصطناعي القوي جدا بلعبة Go باستخدام استراتيجية اقترحها ذكاء اصطناعي آخر

ft.com

- اخبار متواردة ان بعض شركات الاعلام العالمية ستطالب OpenAI بالدفع مقابل استخدام معلوماتها واخبارها في تدريب الذكاء الاصطناعي واجابات اسئلة مستخدمي ChatGPT. فهل تتحرك قوى السوق لتحقيق معادلة طبيعية تحد من تمدد الذكاء الاصطناعي؟ هذا ممكن ايضا.

slashdot.org

slashdot.org

شخصيا مثل هذه اللقاءات تجعلك تفكر اكثر خارج الصندوق لذا فهي جميلة برأيي ولكن علينا ان نعي ان المستقبل بيد رب العالمين ثم بيد الانسان.

- رابط اللقاء كامل لمن اراد متابعته. اللقاء حوالي ساعتين لكن شخصيا اراه يستحق المتابعة للمهتمين.

youtu.be

تحياتي

- رابط اللقاء كامل لمن اراد متابعته. اللقاء حوالي ساعتين لكن شخصيا اراه يستحق المتابعة للمهتمين.

youtu.be

تحياتي

يهمني رأيكم ..

جاري تحميل الاقتراحات...