ومن الخوارزميات التي تتبع هذه الطريقة :

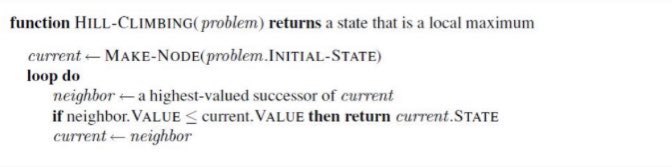

1- Hill-Climbing

2 - Simulated Annealing

3- Local Beam

4- Genetic Algorithm

هذا باختصار نبذة بسيطة عن النوعين او الطريقتين للبحث عن حل للمشكلات في خوارزميات الذكاء الاصطناعي🥳🤍

الحين ننتقل لموضووعنا🤩..

1- Hill-Climbing

2 - Simulated Annealing

3- Local Beam

4- Genetic Algorithm

هذا باختصار نبذة بسيطة عن النوعين او الطريقتين للبحث عن حل للمشكلات في خوارزميات الذكاء الاصطناعي🥳🤍

الحين ننتقل لموضووعنا🤩..

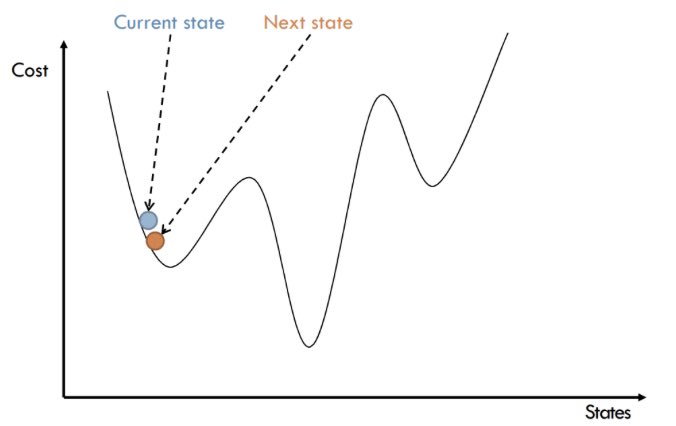

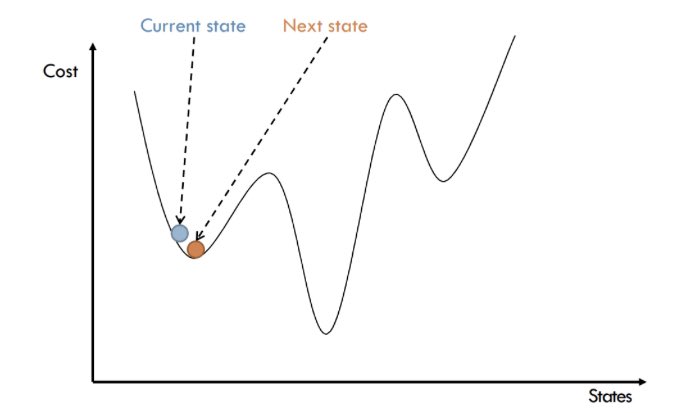

بالنسبة لعملية الصعود او اللانتقال للحالة الافضل لها حالتين او two versions :

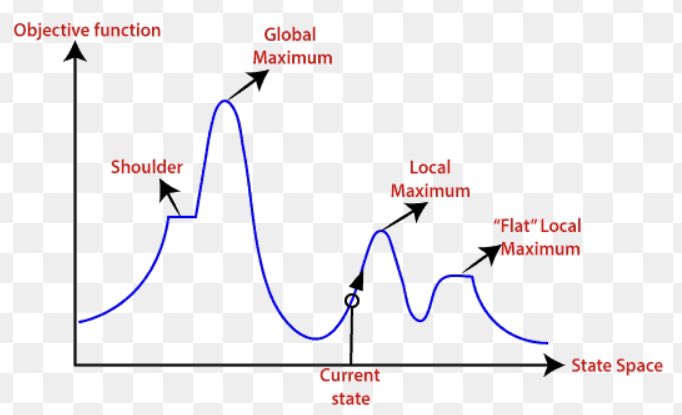

1- steepest ascent version : يعني ان عملية الصعود تكون للاعلى بيانيا، و الانتقال للحالة التالية يكون للحالة اللي عندها قيمة اعلى عدديا ،ونقدر نعرف اذا كان مكتوب على الرسم البياني (objective function)✅

1- steepest ascent version : يعني ان عملية الصعود تكون للاعلى بيانيا، و الانتقال للحالة التالية يكون للحالة اللي عندها قيمة اعلى عدديا ،ونقدر نعرف اذا كان مكتوب على الرسم البياني (objective function)✅

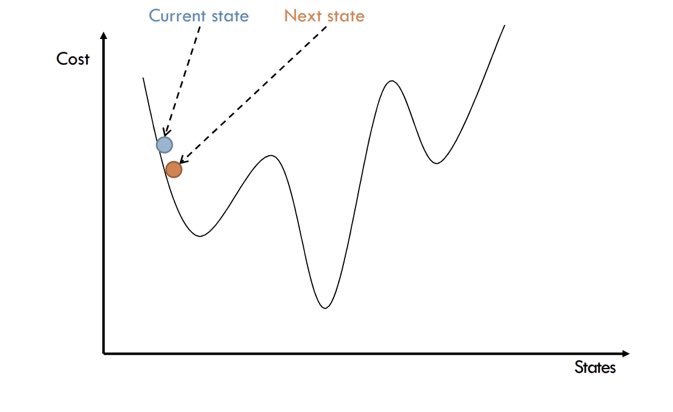

2- steepest-descent version : يعني ان عملية الصعود تكون للاسفل بيانيا و الانتقال للحالة التالية يكون للحالة اللي عندها قيمة اقل عدديا ،ونقدر نعرف اذا كان مكتوب على الرسم البياني (cost)

- لان التكلفة في البحث نبغاها تكون اقل مو اكثر وبالتالي الحالة الاحسن هي الاقل عدديا في التكلفة

- لان التكلفة في البحث نبغاها تكون اقل مو اكثر وبالتالي الحالة الاحسن هي الاقل عدديا في التكلفة

وفيما يلي شرح مفصّل لكل نقطة في هذه الرسمة🤔:

Local maximum:

هي اكبر واعلى نقطة بيانيا بالنسبة لباقي الحالات المجاورة لها ولكنها ليست اكبر قيمة في المخطط البياني بالكامل، ليست الحل الافضل👎🏻

Local maximum:

هي اكبر واعلى نقطة بيانيا بالنسبة لباقي الحالات المجاورة لها ولكنها ليست اكبر قيمة في المخطط البياني بالكامل، ليست الحل الافضل👎🏻

2- Global maximum:

هي الحالة أو النقطة الافضل والمثالية

وهي الحل النموذجي للخوارزمية، هي اكبر قيمة بالنسبة للحالات القريبة منها وللمخطط البياني بالكامل .💯🤍

3- Current state:

هي الحالة او النقطة الحالية ( البحث عندها قائم الان )👍🏻

هي الحالة أو النقطة الافضل والمثالية

وهي الحل النموذجي للخوارزمية، هي اكبر قيمة بالنسبة للحالات القريبة منها وللمخطط البياني بالكامل .💯🤍

3- Current state:

هي الحالة او النقطة الحالية ( البحث عندها قائم الان )👍🏻

4- Flat local maximum:

هي منطقة مسطحة تدل على ان كل الحالات القريبة من هذه الحالة لها نفس قيمة الحالة الحالية ( كلهم نفس القيمة العددية )

وبكذا تبيّنت لنا كل نقطة تدل على ايش✅👏🏻

بس عندنا مشكلة راح تخرّب علينا عمل الخوارزمية بالكاااامل!!😔

تعالوا نكتشف ايش هي🏃🏻♀️

هي منطقة مسطحة تدل على ان كل الحالات القريبة من هذه الحالة لها نفس قيمة الحالة الحالية ( كلهم نفس القيمة العددية )

وبكذا تبيّنت لنا كل نقطة تدل على ايش✅👏🏻

بس عندنا مشكلة راح تخرّب علينا عمل الخوارزمية بالكاااامل!!😔

تعالوا نكتشف ايش هي🏃🏻♀️

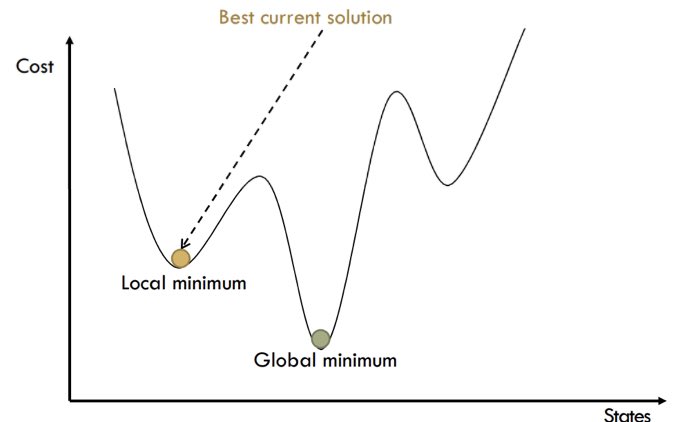

هذه هي المشكلة بالضببط !!

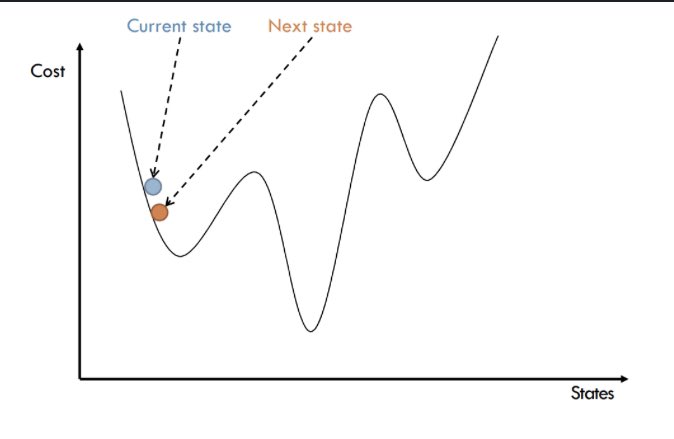

المفروض ان الخوارزمية تسمح بانها تعاكس حركتها الصحيحة ( النزول ) وتسمح بحركة ( الصعود للاعلى ) ببعض الحالات

لان فيه حلول أفضل وأحسن تقدر تلقاها!💡

ولذلك تعتبر مشكلة عدم السماح بانها تتحرك حركات خاطئة في بعض الاحيان مشكلة كبيرة!

المفروض ان الخوارزمية تسمح بانها تعاكس حركتها الصحيحة ( النزول ) وتسمح بحركة ( الصعود للاعلى ) ببعض الحالات

لان فيه حلول أفضل وأحسن تقدر تلقاها!💡

ولذلك تعتبر مشكلة عدم السماح بانها تتحرك حركات خاطئة في بعض الاحيان مشكلة كبيرة!

عُلماء الذكاء الاصطناعي ابتكروا خواررمية اخرى لحل هذه المشكلة🥳

وصارت تسمح بأنها تسوي بعض الحركات الخاطئة بنسب معينة ( نسب احتمالية ولها قانونها الخاص رياضيّا ) وراح تكون نسبة حدوثها قليلة حتى نوصل لحل أفضل ومثالي🤩💓

واسم هذه الخوارزمية :

simulated annealing 🤍algorithm

وصارت تسمح بأنها تسوي بعض الحركات الخاطئة بنسب معينة ( نسب احتمالية ولها قانونها الخاص رياضيّا ) وراح تكون نسبة حدوثها قليلة حتى نوصل لحل أفضل ومثالي🤩💓

واسم هذه الخوارزمية :

simulated annealing 🤍algorithm

جاري تحميل الاقتراحات...