ماهو الفرق بين standardization و normalization؟

يساعد تحويل البيانات (Data transformation) على زيادة دقة نماذج #تعلم_الآلة (Machine Learning)، أسفل التغريدة سنشرح الفرق بين توحيد البيانات و تطبيعها، ومتى وكيف يتم تطبيق كل منهجية مع أمثلة وكود بلغة Python

kdnuggets.com

يساعد تحويل البيانات (Data transformation) على زيادة دقة نماذج #تعلم_الآلة (Machine Learning)، أسفل التغريدة سنشرح الفرق بين توحيد البيانات و تطبيعها، ومتى وكيف يتم تطبيق كل منهجية مع أمثلة وكود بلغة Python

kdnuggets.com

تحويل البيانات إحدى الخطوات الأساسية في مرحلة معالجة وتجهيز البيانات لمرحلة بناء النماذج، قد نقوم بتحويل البيانات من نوع إلى نوع (بيانات أسمية إلى رقمية أو العكس) ، وكذلك قد نقوم بتحويلها من مقاس إلى مقاس آخر (features rescaling)

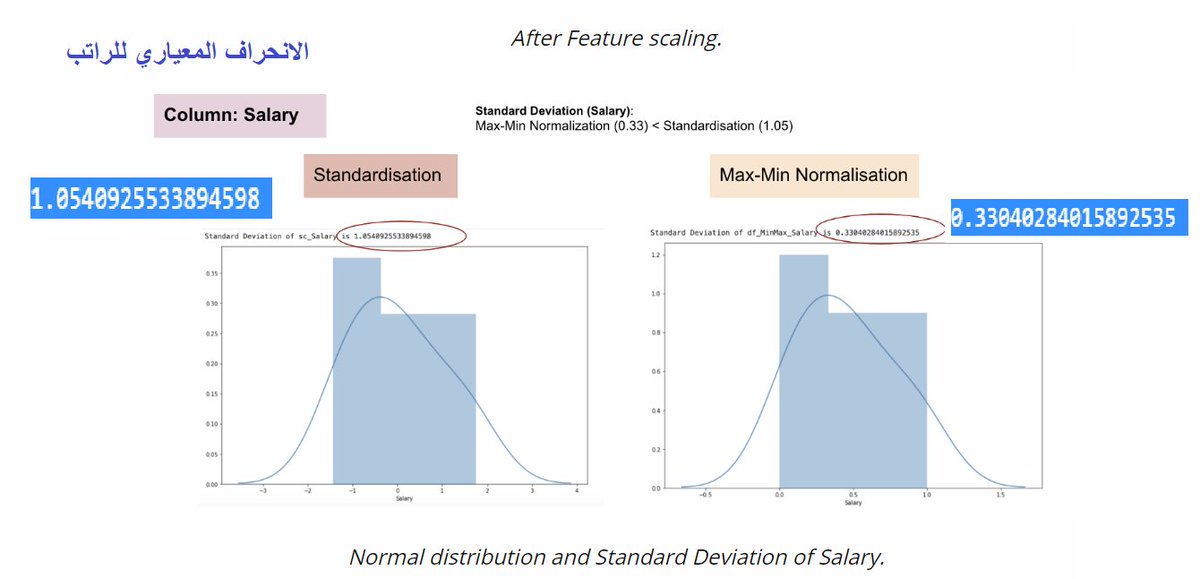

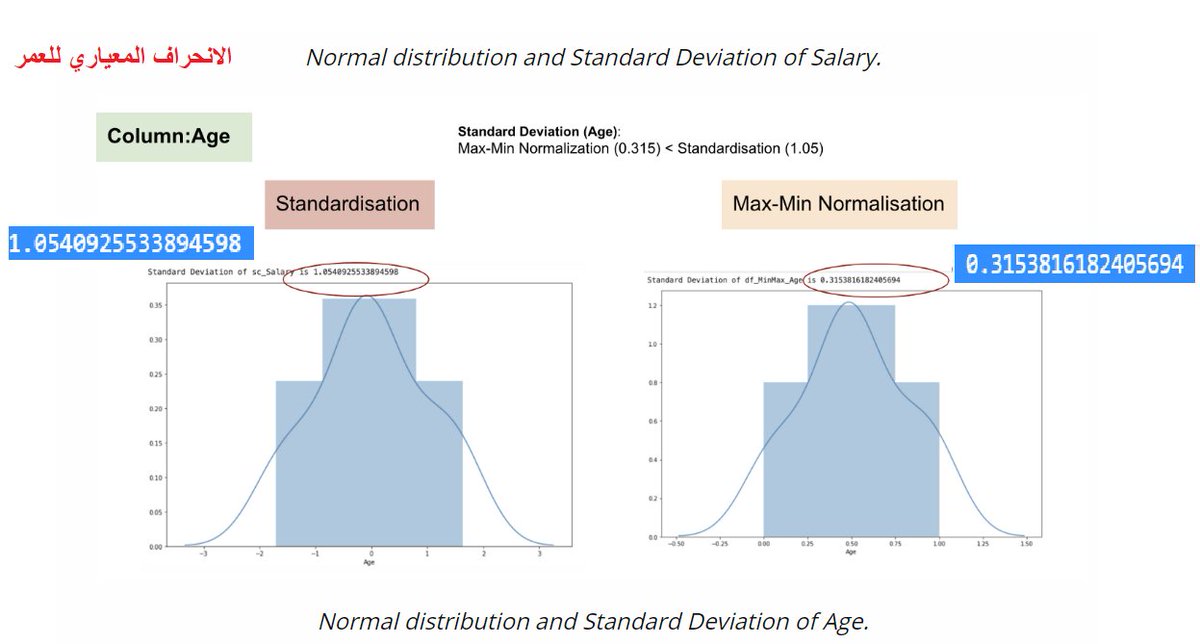

هناك طريقتان لتحويل البيانات من مقاس إلى مقاس آخر:

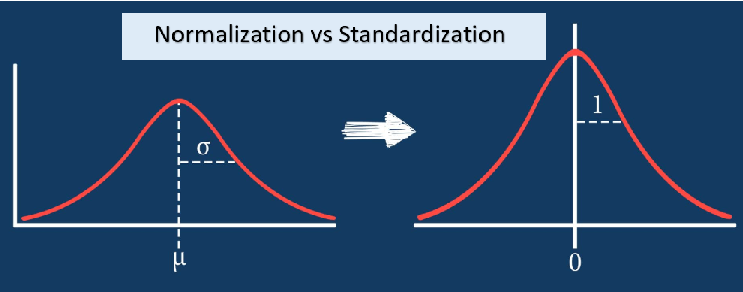

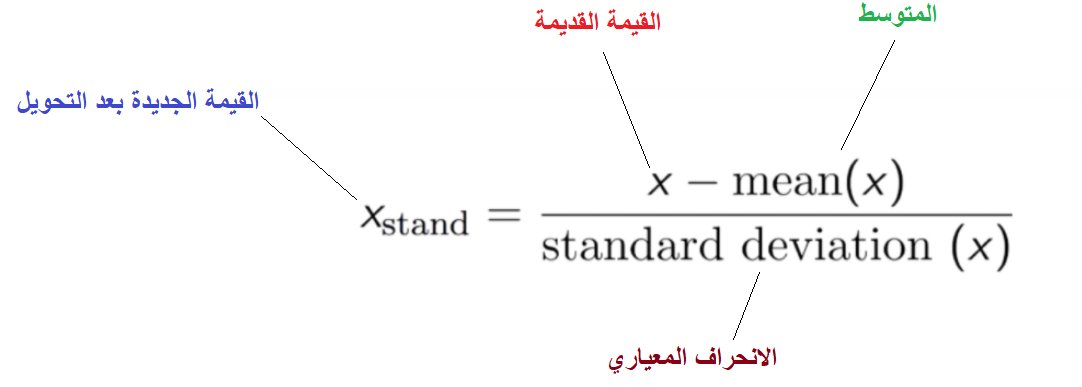

📍توحيد البيانات (standarization)

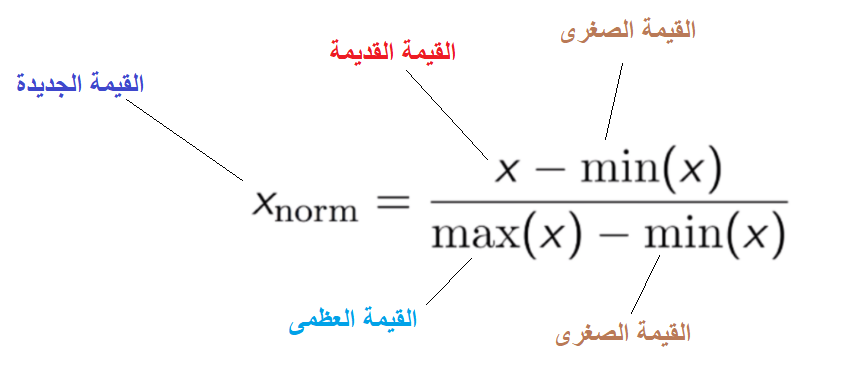

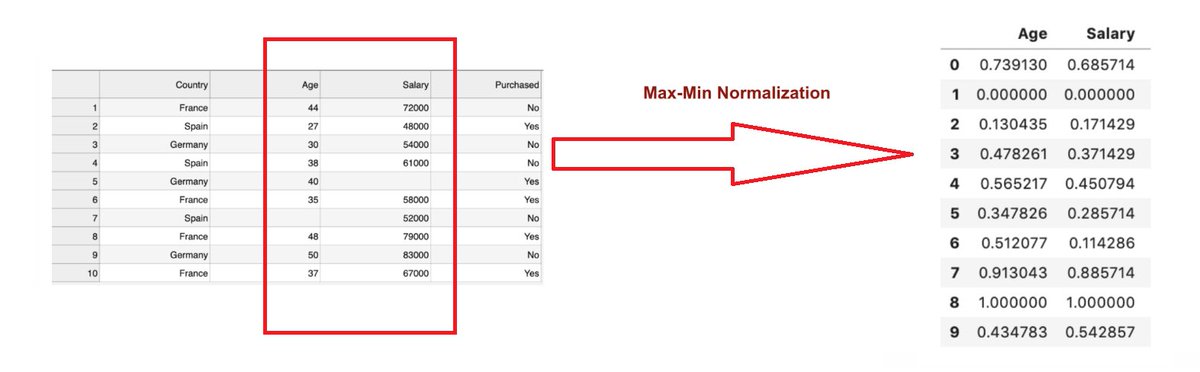

📍تطبيع البيانات (normalization)

يُطلق على توحيد البيانات (z-score normalization) ، وتطبيع البيانات يسمونه (Max-Min normalization) ... وسنعرف لماذا؟

📍توحيد البيانات (standarization)

📍تطبيع البيانات (normalization)

يُطلق على توحيد البيانات (z-score normalization) ، وتطبيع البيانات يسمونه (Max-Min normalization) ... وسنعرف لماذا؟

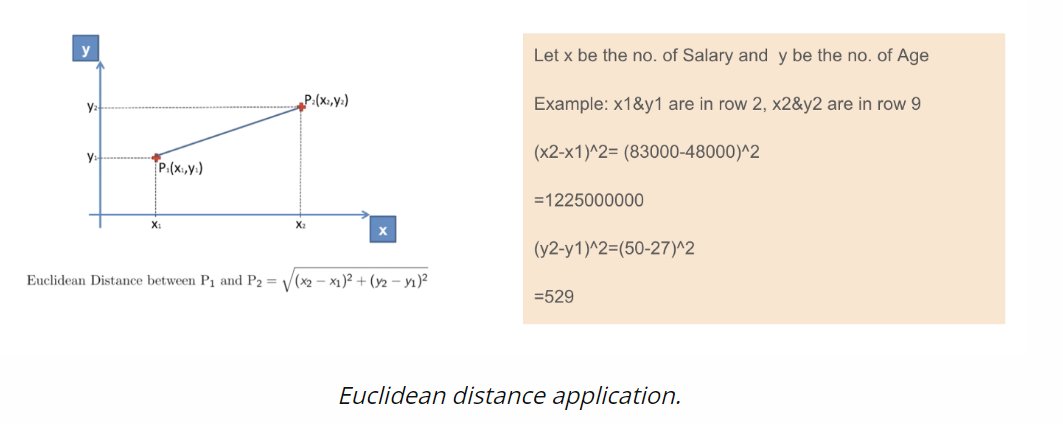

لماذا نحتاج هذا التحويل؟

في الحياة العملية غالباً مانواجه بيانات بمقاسات مختلفة مثل الراتب والعمر ، استخدام المقاس الأصلي لكل متغير عند تدريب خوارزميات تعلم الآلة يؤدي إلى إعطاء وزن أعلى للمتغير صاحب النطاق الأكبر (الراتب)، لذا نحتاج تحويل كل المتغيرات إلى نطاق موحد (range)

في الحياة العملية غالباً مانواجه بيانات بمقاسات مختلفة مثل الراتب والعمر ، استخدام المقاس الأصلي لكل متغير عند تدريب خوارزميات تعلم الآلة يؤدي إلى إعطاء وزن أعلى للمتغير صاحب النطاق الأكبر (الراتب)، لذا نحتاج تحويل كل المتغيرات إلى نطاق موحد (range)

لذلك إذا كان لدينا قيم متطرفة (outliers) فإن عملية التطبيع (normalization) تؤدي إلى تحويل قيم البيانات إلى مقياس صغير (كل الخصائص لها نفس الحجم)، بعكس التوحيد (standarization) والذي يُنصح به في حالة وجود قيم متطرفة لقوته ، وفي كثير من الأحيان يُفضل التوحيد على التطبيع

للمهتمين بالموضوع هنا رابط بيانات المثال الي ذكرناه مع كود Python لعملية التوحيد وعملية التطبيع:

github.com

مزيد من الأمثلة والأكواد أيضاً في هذا المقال:

@swethalakshmanan14/how-when-and-why-should-you-normalize-standardize-rescale-your-data-3f083def38ff" target="_blank" rel="noopener" onclick="event.stopPropagation()">medium.com

github.com

مزيد من الأمثلة والأكواد أيضاً في هذا المقال:

@swethalakshmanan14/how-when-and-why-should-you-normalize-standardize-rescale-your-data-3f083def38ff" target="_blank" rel="noopener" onclick="event.stopPropagation()">medium.com

@cona2020 صحيح

جاري تحميل الاقتراحات...